Neuronale Netze: Die Tücken der Objekterkennung

Unterschiedliche Fahrzeuge digital zu erkennen, ist an sich schon eine Herausforderung. Das in Echtzeit zu tun erst recht. Dr. Claus Lenz vom Providentia++-Partner Cognition Factory über die Tücken der Objekterkennung auf der A9.

Herr Lenz, Sie haben sich in Ihrer Bachelorarbeit mit Spracherkennung befasst und in der Masterarbeit einen Automatismus für Videos entwickelt, mit dem Sie einen Mitschnitt generieren, der das Wesentliche enthält. In Providentia++ geht es nun darum, Fahrzeuge zu identifizieren. Wie hängt das eine mit dem anderen zusammen?

Der Schwerpunkt in meinem Studium lag in der Mensch-Maschine-Kommunikation. Für meine Diplomarbeit habe ich damals mit einem „asynchronen Hidden-Markov-Modell“ gearbeitet. Heute würde man dazu wahrscheinlich künstliche Intelligenz sagen. Für meine Promotion habe ich mich im Forschungsprojekt CoTeSys dann auf die Mensch-Roboter-Kollaboration konzentriert, wo es darum ging, dass Menschen und Roboter gemeinsam Produktionsaufgaben lösen. Gemeinsam ist allen Aufgaben, dass einer Maschine Stück für Stück beigebracht wird, dazuzulernen und eine Aufgabe selbständig zu lösen. Einmal geht es darum, Sprache zu erkennen, dann wichtige Passagen in Videos zu identifizieren und jetzt – in Providentia++ – darum, verschiedene Klassen von Fahrzeugen so zuverlässig wie möglich voneinander zu unterscheiden. Die gewonnen Daten werden analysiert und daraus im besten Fall Empfehlungen abgeleitet.

Wie gehen Sie in Providentia++ vor?

Anders als in der Grundlagenforschung nutzen wir Lösungen, die bereits etabliert sind, setzen also auf Architekturen auf, die bereits entwickelt und vortrainiert wurden. Wir arbeiten also zunächst mit Standarddatensätze und verbessern das System dann kontinuierlich mit eigenen Daten. Eine der Hauptaufgaben in dem Bereich besteht immer darin, sowohl geeignete Herangehensweisen, als auch geeignete Datensätze zu finden und diese für die Algorithmen aufzubereiten. Zum Beispiel gab es zu Beginn des Projekts eine Menge Daten aus der Perspektive eines Fahrzeugs, etwa zum Training von Assistenzsystemen. Daten aus der Überwachung – also aus der Perspektive von außen von oben schräg auf das Fahrzeug – gab es allerdings nur wenige.

Wie haben Sie dem System dann beigebracht, zwischen Auto, Lastwagen und Lieferwagen zu unterscheiden?

Wie bereits gesagt, geht es letztlich darum, die passenden Ansätze mit geeigneten Datensätzen zusammenzubringen. Das heißt: Wenn nicht genügend Daten aus der Anwendung vorhanden sind, müssen neue Datensätze erstellt werden. Da steckt dann oft viel manuelle Arbeit drin, denn die Bilder müssen annotiert werden. Das bedeutet, dass einem Bild, das von der Kamera aufgenommen wird, Informationen hinzugefügt werden. Wir sprechen von „labeln“, wenn etwa ein Rechteck um ein Fahrzeug gezeichnet wird. Durch jede einzelne Annotation lernt das System dazu und kann nach und nach immer besser zwischen den Fahrzeugklassen unterscheiden. Das ist nach einer gewissen Zeit sehr präzise möglich. Muss das System allerdings in Bruchteilen einer Sekunde entscheiden, also quasi in Echtzeit die richtige Entscheidung treffen, lassen sich Fehler nie ganz vermeiden. Es kann also vorkommen, dass Fahrzeuge nicht sofort eindeutig einer Klasse zugeordnet werden. Hier helfen uns dann zusätzliche Informationsquellen wie Radarsensoren oder auch die zeitliche Abfolge, also also die zeitliche Verfolgung der Fahrzeuge. Generell gilt: Entweder sind Systeme schnell und eher ungenau oder aber eher langsam und präzise. In Providentia++ besteht also die Herausforderung darin, einen Mittelweg zu finden.

Auch das Wetter und die Lichtverhältnisse spielen in die Qualität der Objekterkennung hinein. Wie lässt sich mit diesen Einflussfaktoren umgehen?

Die Qualität der Objekterkennung hängt maßgeblich von drei Faktoren ab, von der Hardware (I.), also den Sensoren und der damit einhergehenden Datenqualität, der Software (II.), sprich der Robustheit der zur Verfügung stehenden Algorithmen sowie der Umwelt (III.), also etwa den Wetterbedingungen. Wenn es schneit oder stark regnet, lassen sich Reflexionen, Streulicht oder Kränze um Lichtquellen kaum verhindern. Schon wenn nur eine Wolke vorbeizieht, kann das die Bildqualität durch Rauschen beeinträchtigen und somit die Erkennung beeinflussen. Aktuell erkennen unsere Algorithmen Pkws generell besser als Lkws oder Busse – einfach, weil es mehr und bessere Daten davon gibt. Standarddaten von Lkws und Bussen etwa stammen oft aus den USA oder Asien, wo diese etwas anders aussehen als in Europa. Hier mangelt es also noch an „Lehrmaterial“. Über die Kameras von Providentia++ können wir hier die nötigen Informationen sammeln.

Auf Basis der Objekterkennung lassen sich Fahrzeuge klassifizieren und Wege von Fahrzeugen nachvollziehen. Welche Analysen sind auf Basis dieser Daten denkbar?

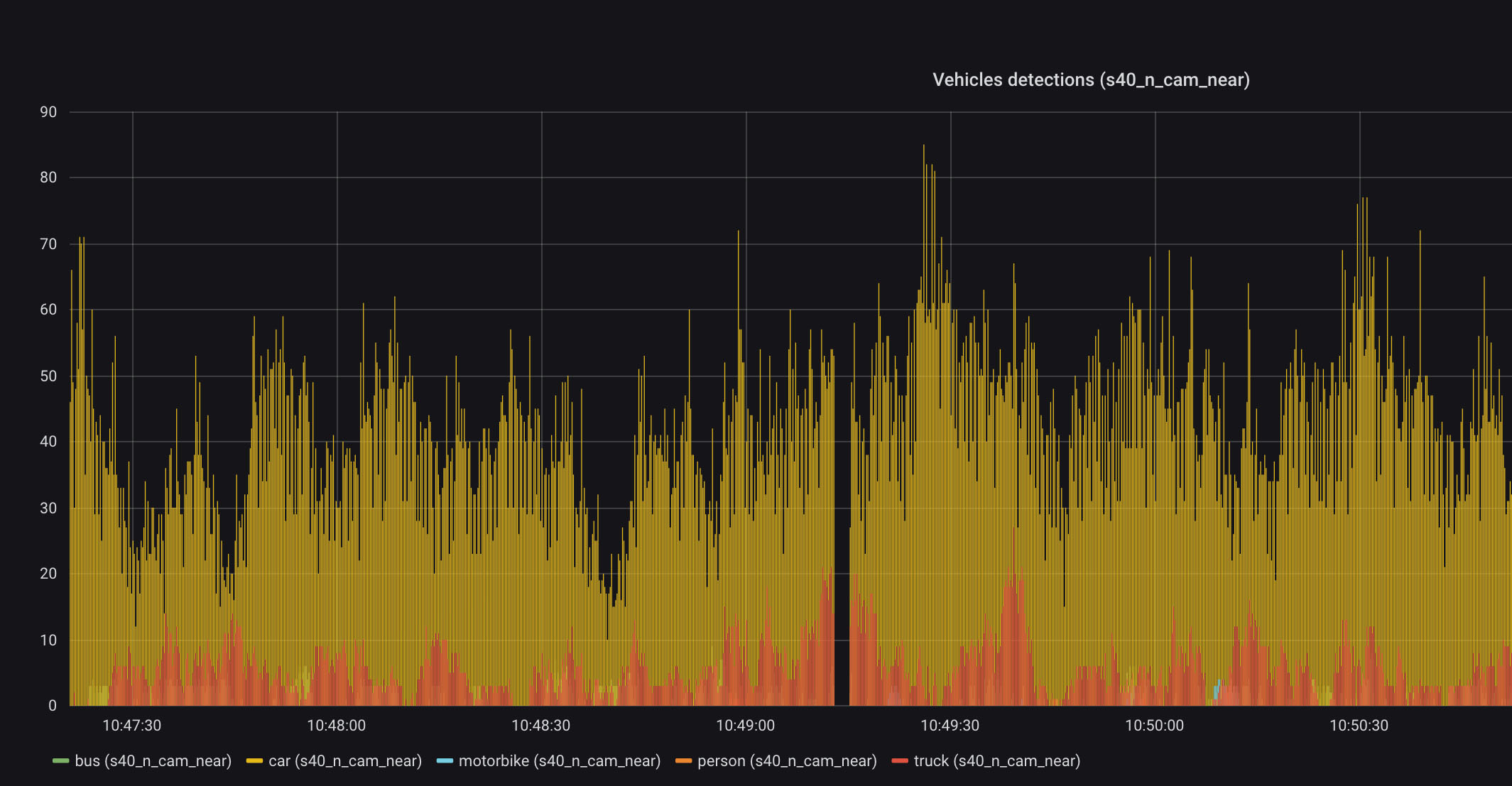

Wir sind mit unseren Algorithmen in der Lage, etwa 20 Mal pro Sekunde eine Momentaufnahme des Verkehrs zu registrieren und speichern diese Daten über hundert Tage. Es ist also möglich, herauszubekommen, wie viele Pkws, Lkws und Busse am 22. Oktober 2020 um 12:21 auf dem Weg von München nach Nürnberg gerade in Garching vorbeikamen. Viel spannender ist es allerdings, beispielsweise zu analysieren, welche Spuren besonders ausgelastet sind und daraus Manöverempfehlungen abzuleiten. Also folgender Frage nachzugehen: Bei welcher Verkehrsdichte werden Spuren häufig gewechselt und wie lässt sich das verhindern?

Ist es möglich, auch spezielle Automarken zu erkennen oder Elektrofahrzeuge und Verbrenner auseinanderzuhalten?

Generell ja. Allerdings haben unsere Forschungen im Bereich Car Model Make Recognition gezeigt, dass die Bestimmung des genauen Fahrzeugmodells noch zu lange dauert für einen Echtzeitbetrieb: Die Kameras sehen zwischen 50 und 100 Fahrzeuge auf einem einzigen Bild, und jedes davon muss analysiert werden. Für die Anwendungen, die in Providentia++ geplant sind, reicht es zunächst aus, die Fahrzeuge in übergeordnete Kategorien wie Auto, LKW, Motorrad, oder Bus einzuordnen. Damit garantieren wir auch eine durchgängige Verarbeitung der Daten in Echtzeit.

In der nächsten Phase von Providentia++ wird auch der Verkehr im „urbanen“ Raum erforscht. Das heißt auch, dass etwa Fußgänger, Radfahrer und Motorräder mit einbezogen werden müssen. Wie gehen Sie hier vor?

Wir haben die Architektur unseres Systems so gestaltet, dass wir immer neue Funktionalitäten mit aufnehmen können. Die Erkennung von Menschen etwa haben wir bereits jetzt integriert. So werden etwa Personen in Fahrzeugen erkannt oder Motorräder und Menschen separat klassifiziert. Künstliche Neuronale Netze entfalten ja gerade dann ihre besondere Stärke, wenn sie in einem eingeschränkten, klar umgrenzten Bereich eingesetzt werden. Am besten ist es also, jeweils eigene Algorithmen für die Erkennung von Fahrrädern, Fußgängern und Fahrzeugen einzusetzen und diese zum Schluss zusammenzuführen.

Hinweis: Im Bereich der Bilderkennung verwendet man oft so genannte Convolutional Neuronal Networks, wobei sich gewissermaßen Filter über das gesamte Bild schieben und Stück für Stück analysieren. So lassen sich die Merkmale des Bildes extrahieren, die dann klassifiziert werden. Weitere Informationen zur Methode des Convolutional Neuronal Networks finden Sie auch im Whitepaper „A Non-Technical Survey on Deep Convolutional Neural Network Architectures“, von Felix Altenberger und Dr. Claus Lenz, 2018.

WEITERE AKTUELLE THEMEN

Cognition Factory: Kameradaten auswerten und visualisieren

Seit Beginn der Forschungen in Providentia++ am digitalen Zwilling ist KI-Spezialist Cognition Factory GmbH auf die Verarbeitung von Kameradaten fokussiert. Geschäftsführer Dr. Claus Lenz mit seinem Resümee.

Digitaler Echtzeitzwilling des Verkehrs: Serienreif und rund um die Uhr einsetzbar

Konsortialführer TU München hat das Forschungsprojekt für automatisiertes und autonomes Fahren Providentia++ entscheidend vorangebracht. TUM-Projektleiter Venkatnarayanan Lakshminarashiman zieht Bilanz.

Elektrobit: Test Lab auf stationäre Daten münzen

Elektrobit legt nicht zuletzt durch die Fortschritte in Providentia++ die Basis für Big-Data-Auswertungen von Verkehrsdaten. Simon Tiedemann von Elektrobit über die Entwicklungen im Rahmen von P++.