Plausibilitäts-Checks von Sensoren: In Netzwerken besonders effizient

Um herauszufinden, ob ein Sensor einer externen Infrastruktur auch das Richtige misst, hat Intel einen Plausibilitäts-Check entwickelt. Je mehr Sensoren in einem Netzwerk wie etwa bei Providentia++ eingebunden sind, umso besser lassen sich Fehler finden. Intel-Forscher Dr. Florian Geissler über die Kunst, schlechte Messungen zu identifizieren und auszuschließen.

Herr Geissler, um mithilfe von vernetztem Fahren den Verkehr (etwa den Durchfluss) zu verbessern, ist auch eine zuverlässige Infrastruktur nötig. Das ist sie nicht immer. Welche Probleme und Fehler können auftreten?

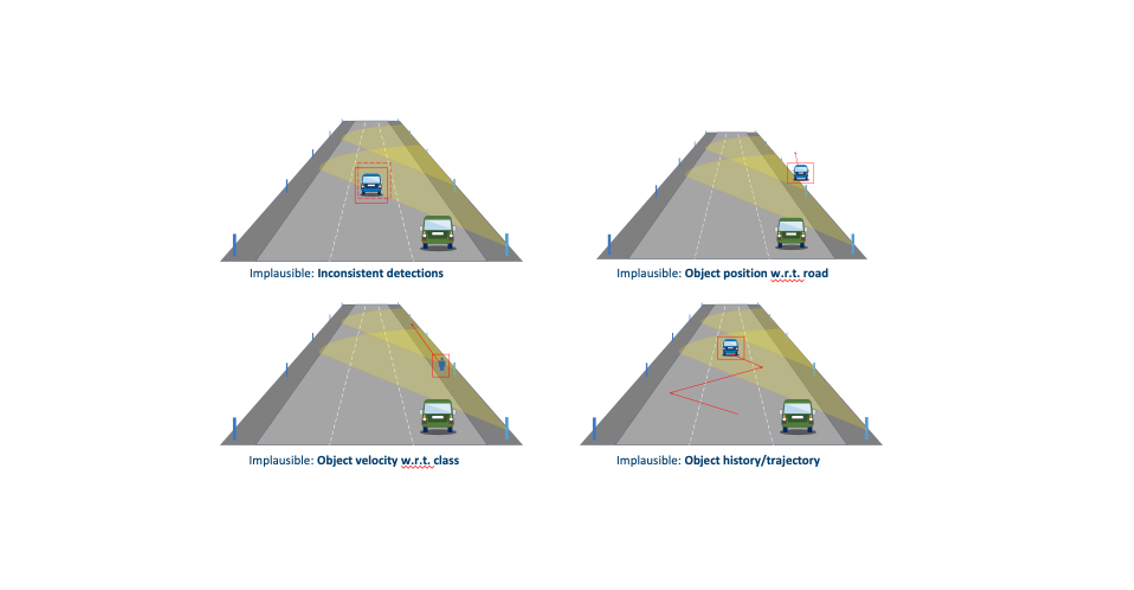

Es gibt viele Möglichkeiten. Sei es, dass der Sensor unmerklich etwas gedreht wurde, die Linse verschmutzt ist oder der Sensor ein ungewöhnlich starkes Rauschen aufweist. Und schon verpasst ein Sensor im Sensornetzwerk ein Objekt. Fahrzeuge befinden sich außerhalb der Straßenkarte, was sehr unwahrscheinlich ist. Fußgänger sind schneller unterwegs als sie es physikalisch sein dürften und die Bewegungslinien (Trajektorien) von Objekten verlaufen in Sprüngen oder Zickzack-Linien. Um herauszufinden, ob die Ergebnisse eines Systems plausibel sind, haben wir ein Modell entwickelt, das für jedes erkannte Objekt einen so genannten Plausibilitäts-Score errechnet, einen Wert zwischen 0 (nicht plausibel) und 1 (äußerst plausibel). Das Modell ist für alle Sensornetzwerke einsetzbar – also einerseits beim vernetzten und kollaborativen Fahren, gleichermaßen aber auch in anderen Bereichen wie in der Robotik.

Netze von Sensoren: Entscheidend für vernetztes und kollaboratives Fahren

Wie gehen Sie vor?

Das Ziel besteht darin, die Wahrnehmung von Objekten zu verifizieren. Das gelingt umso besser, je mehr Sensoren Sie haben, die sich in ihrem Sichtfeld überlappen. Bei einem Fahrzeug etwa sind nicht alle Bilder replizierbar, einfach, weil die Sensoren nicht redundant ausgelegt sind. Um Wahrnehmung zu plausibilisieren, kann also eine zweite Sicht auf die Dinge Sinn machen. Abgesehen davon versuchen wir, die Intuition, die einen Menschen im Verkehr auszeichnet, nachzubilden, was wir etwa im Forschungsprojekt KoRA9 bereits anhand von Radaren untersucht haben. Wenn etwa ein LKW nah an einer Leitplanke entlangfährt, kann es passieren, dass der Radar die Reflexionen der Leitplanke misst. Das Fahrzeug würde sich dann allerdings außerhalb der Fahrbahn befinden. Hier sollte das System auch ohne eine Ground Truth in der Lage sein zu erkennen, dass das nicht schlüssig ist. Klar ist aber auch: Mit vielen Sensoren wird unser System besonders effizient.

Wo sehen Sie besondere Vorteile Ihres Plausibilitäts-Checks?

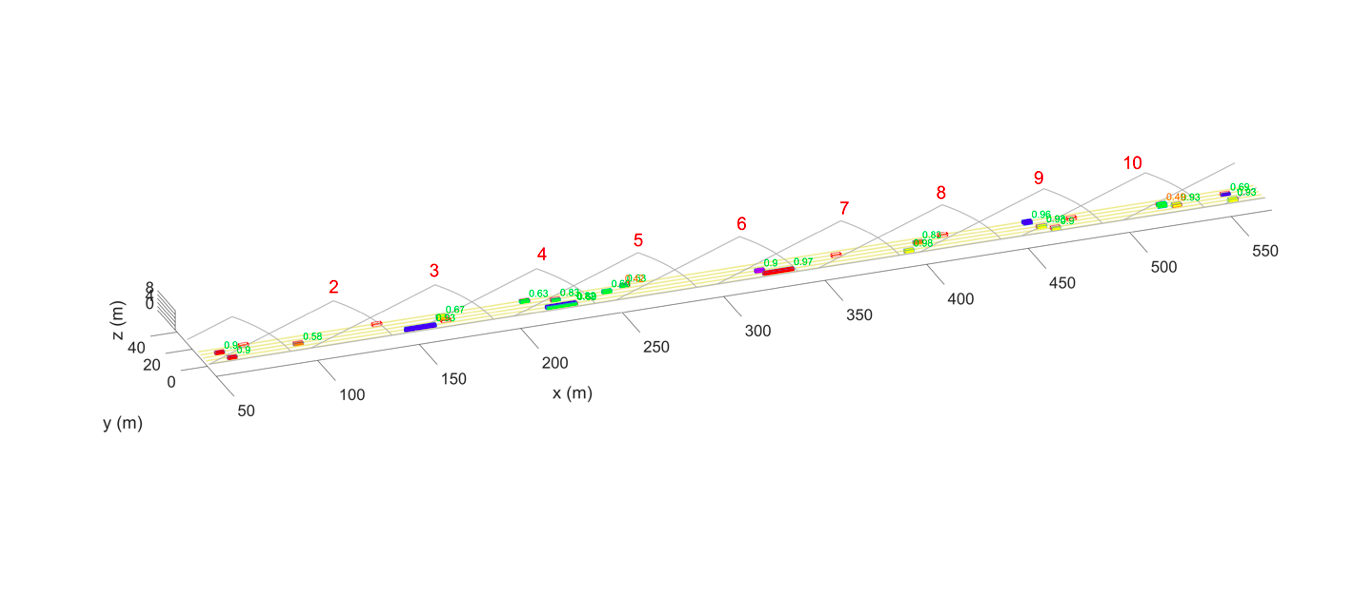

Unser Plausibilitäts-Score basiert auf Sensoren der externen Infrastruktur sowie vernetzten Sensoren aus Fahrzeugen. So erweitern wir die begrenzte Perspektive des einzelnen Fahrzeugs und dessen Sensorik an Bord. Zudem füttern wir unser Plausibilitätsmodul mit dreierlei Daten: Im Single Check finden einzelne Sensoren bereits Fehler (etwa eine ungewöhnliche Signal-to-Noise-Ratio, Bewegungen außerhalb der Straßengrenzen etc.), ein Cross Check korreliert die Sicht von mindestens zwei Sensoren auf den gleichen Sichtbereich miteinander (erkennen alle Sensoren ein Objekt?) und in Model-basierte Checks werden einerseits mehrere Sensoren eingebunden, aber auch Verbindungen zwischen den Daten hergestellt (etwa über komplexe Trajektorien, oder bezüglich verschiedenen Eigenschaften des gleichen Objektes wie Geschwindigkeit und Klasse). Aus diesen Informationen berechnet unser System einen Plausibilitätswert (zwischen 0 und 1) für jedes einzelne Objekt, das auf der Straße unterwegs ist. Diese Plausibilisierung findet parallel zur Datenfusion (siehe auch: Viele Sensoren, ein digitaler Zwilling: Wie geht das?) statt und ist Teil der Gesamtdatenfusion.

Typische Fehler in der Detektion (I.)

Plausibilität-Score von Objekten (II.)

Plausibilität-Signatur (III.)

Plausibilität von Sensordaten: Erkenntnisse über charakteristische Signaturen

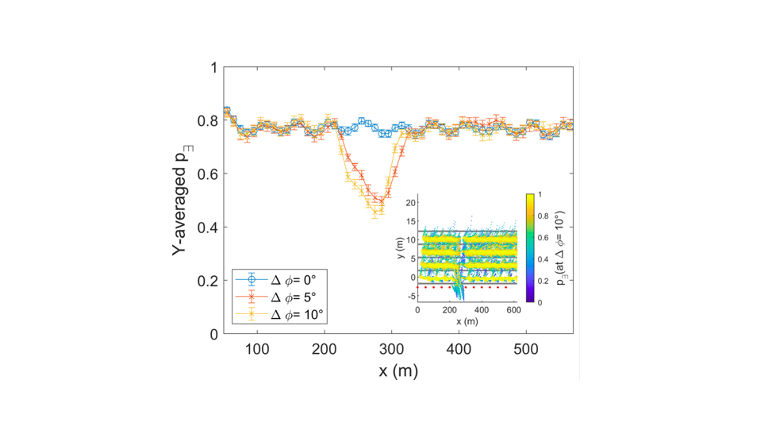

In einer Simulation haben Sie drei typische Fehler getrennt analysiert. Mit welchem Ergebnis?

Im ersten Fall hat sich der Sensor etwas zur Seite gedreht. Das Gesamtsystem weiß aber nichts von dem leichten Perspektivwechsel. Im zweiten Fall wurden Sensoren falsch konfiguriert, Rauschsignale missinterpretiert und dadurch zu viele Fahrzeuge erkannt. Im dritten Fall erkennt ein Sensor (von zweien, die im Einsatz sind) nicht alle Objekte, weil die Sensorlinse verschmutzt ist. Aus den Plausibilitäts-Signaturen zeigt sich, um welche Fehler es sich jeweils handelt. Beim ersten Fehler steigt die Fehlerquote des betroffenen Sensors auf über 60 Prozent, beim zweiten steigen bei den Nachbarsensoren des fehlerhaften Sensors die Fehlerquoten an, ein charakteristisches Bild für Konfigurationsmängel. Auch beim dritten Fehler ergibt sich ein charakteristisches Bild. Hier zeigt sich besonders, wie wichtig es ist, für das Monitoring möglichst viele Sensoren im Sensornetzwerk zu betrachten, was wir zum Beispiel im Forschungsprojekt Providentia++ tun. Klar ist aber auch: Unser Modell detektiert Fehler, behebt sie aber nicht. Das ist Aufgabe der Gesamtdatenfusion.

Weitere wissenschaftlichen Informationen zu Plausibilitäts-Checks finden Sie in der folgenden Publikation:

A Plausibility-Based Fault Detection Method for High-Level Fusion Perception Systems

Von Florian Geissler, Alexander Unnervik und Michael Paulitsch

WEITERE AKTUELLE THEMEN

Cognition Factory: Kameradaten auswerten und visualisieren

Seit Beginn der Forschungen in Providentia++ am digitalen Zwilling ist KI-Spezialist Cognition Factory GmbH auf die Verarbeitung von Kameradaten fokussiert. Geschäftsführer Dr. Claus Lenz mit seinem Resümee.

Digitaler Echtzeitzwilling des Verkehrs: Serienreif und rund um die Uhr einsetzbar

Konsortialführer TU München hat das Forschungsprojekt für automatisiertes und autonomes Fahren Providentia++ entscheidend vorangebracht. TUM-Projektleiter Venkatnarayanan Lakshminarashiman zieht Bilanz.

Elektrobit: Test Lab auf stationäre Daten münzen

Elektrobit legt nicht zuletzt durch die Fortschritte in Providentia++ die Basis für Big-Data-Auswertungen von Verkehrsdaten. Simon Tiedemann von Elektrobit über die Entwicklungen im Rahmen von P++.